Ξαφνικά είναι παντού, καταστρέφοντας την ιδέα της εργασίας όπως την ξέρουμε και ανησυχούν τους συγγραφείς σε όλο τον κόσμο. Λίγες τεχνολογίες έχουν καταγράψει δημόσια φαντασία όπως το σύγχρονο chatbot: χρειάστηκε το Chatgpt μόλις δύο μήνες για να φτάσει τα 100 εκατομμύρια χρήστες, ένα κατόρθωμα που πήρε το Instagram δύο χρόνια. Είναι κατανοητό ότι οι εταιρείες τεχνολογίας τώρα αγωνίζονται να ξεκινήσουν τα δικά τους bots. Η Microsoft έχει ψήσει συνομιλητή AI σε αναζήτηση Bing και η Bard της Google πρόκειται να ξεκινήσει κάθε μέρα.

Φυσικά, τα chatbots δεν είναι κάτι καινούργιο. Αυτά τα συστήματα είναι περισσότερο ή λιγότερο οι επόμενες γενιές βοηθών φωνής όπως η Alexa ή η Siri και αναμφισβήτητα όλοι μοιράζονται έναν κοινό πρόγονο, το πρόγραμμα Eliza που δημιουργήθηκε το 1966.

Αν χρησιμοποιούμε κανονική γλώσσα, σύντομα εμφανίζονται ερωτήματα εθιμοτυπίας. Πώς πρέπει να αλληλεπιδράσουμε με chatbots; Έχει σημασία αν είμαστε αγενής σε αυτούς;

Τεχνητά συναισθήματα;

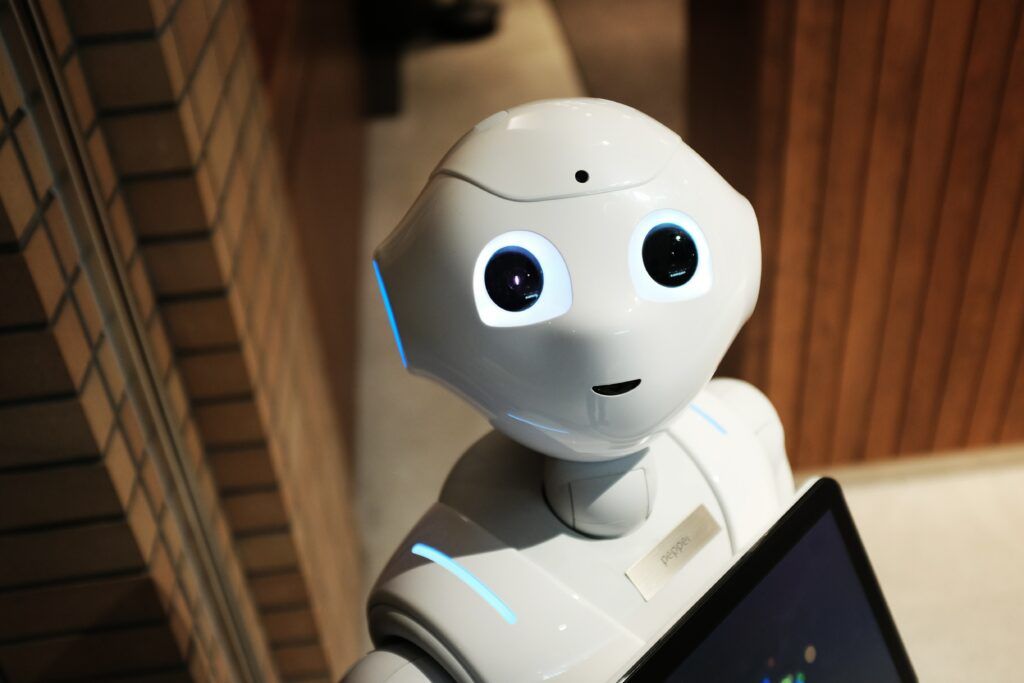

Ένας λόγος που εκτιμούμε ότι είμαστε ευγενικοί είναι ότι δεν θέλουμε να αναστατώσουμε τους άλλους. Αλλά μπορούμε να βλάψουμε τα συναισθήματα ενός chatbot; Πρώτον, θα έπρεπε να έχουν συναισθήματα στην πρώτη θέση. Με άλλα λόγια, το chatbot θα πρέπει να είναι αισθητικός.

Εάν συμφωνήσαμε ποτέ ότι ένα AI ήταν αισθανόμενο, πιθανότατα θα έπρεπε να το αντιμετωπίσουμε πολύ διαφορετικά στα σημερινά μηχανήματα. Θεωρητικά, πρέπει να κάνουμε ό, τι είναι λογικό να αποφύγουμε να προκαλέσουμε πόνο, αν και μπορείτε να υποστηρίξετε τη γεωργία και τις πρακτικές παραγωγής τροφίμων που μας περιλαμβάνουν να κλείσουμε τα μάτια προς τα ευρύτατα δεινά των ζωνών των ζώων.

Πιθανότατα δεν θα γνωρίζουμε ποτέ με βεβαιότητα αν ένα μηχάνημα είναι αισθανόμενο. Δεδομένου ότι δεν μπορούμε να δούμε στα μυαλά των άλλων, δεν μπορούμε ποτέ να μάθουμε τι είναι πραγματικά να είναι τους. Και η ευαισθησία θα μπορούσε να φανεί αρκετά διαφορετική σε μια μηχανή από ό, τι σε έναν άνθρωπο ή ένα ζώο. Αν περιμένουμε ένα μηχάνημα για να δείξει τη συμπεριφορά των ζώων ή του ανθρώπου, ίσως να χάσουμε σημαντικές ενδείξεις ευαισθησίας.

Προς το παρόν, τουλάχιστον, οι ειδικοί συμφωνούν ότι η Machine Sencience απέχει πολύ. Τούτου λεχθέντος, υπήρξε μια αξιοσημείωτη εξαίρεση. Κατά τη δοκιμή μιας πρώιμης έκδοσης αυτού που έχει γίνει από τότε Bard, ο μηχανικός λογισμικού Google Blake Lemoine δημοσίευσε τους ισχυρισμούς ότι το σύστημα μπορεί να είναι αισθητικός. Η εταιρεία σύντομα τον πυροβόλησε για υποτιθέμενη παραβίαση της εμπιστευτικότητας.

Έλλειψη κατανόησης

Αλλά η ευαισθησία δεν είναι όλη η ιστορία. Οι λέξεις βλάπτουν μόνο αν τα καταλαβαίνετε. Είναι εντάξει να είσαι αγενής σε ένα χοίρο – εφ ‘όσον δεν το βλάπτετε φυσικά – γιατί δεν μπορεί να καταλάβει τι λέτε. Επομένως, δεν αρκεί για το υποθετικό μας chatbot να είναι αισθανόμενο: θα πρέπει επίσης να κατανοήσουμε τη γλώσσα.

Τα σύγχρονα chatbots δεν καταλαβαίνουν τη γλώσσα με τον τρόπο που κάνουν οι άνθρωποι και δεν σχηματίζουν τα κατάλληλα μοντέλα για τα διάφορα λόγια και τις έννοιες σε μια πρόταση που πραγματικά σημαίνει. Αντ ‘αυτού, χρησιμοποιώντας τεράστιες συλλογές γραπτών δεδομένων, εκπαιδεύονται για να αναγνωρίσουν ποιες λέξεις τείνουν να ακολουθούν άλλες λέξεις, γεγονός που τους επιτρέπει να δημιουργούν ρεαλιστικό κείμενο. Ουσιαστικά, αυτά είναι εξαιρετικά εξελιγμένα συστήματα αυτόματης συμπλήρωσης, τα ίδια πράγματα που βλέπετε στο πληκτρολόγιο προγνωστικού κειμένου του smartphone σας.

Έτσι ίσως μπορούμε να χαλαρώσουμε. Τα chatbots δεν είναι αισθανόμενα και ούτε μπορούν πραγματικά να καταλάβουν τι λέμε. Είναι πολύ μακρινό να ισχυριστεί κανείς ότι μπορούν να βλάψουν από τα λόγια μας. Γιατί λοιπόν να ασχοληθείτε με το να είστε ευγενικοί;

Συνεργασίες ανθρώπινου/AI

Μια απάντηση είναι ότι αυτά τα συστήματα δεν είναι πλήρως ανεξάρτητα. Ακόμα και τα καλύτερα chatbots χρειάζονται διόρθωση. Πειραματικά εργαλεία όπως το ChatGpt Work Unsvanded, εκτός από το περίεργο τσίμπημα πολιτικής πίσω από το Curtain, αλλά όταν η ακρίβεια έχει σημασία οι άνθρωποι θα λειτουργούν απευθείας με chatbots σε πραγματικό χρόνο. Αυτοί οι ανθρώπινοι βοηθοί θα ενεργούν ως ελεγμένοι και μεταφραστές των γεγονότων, διορθώνοντας την αξιοπρεπή αναξιόπιστη έξοδο chatbot και διευκρινίζοντας διφορούμενες ερωτήσεις.

Μπορούμε να υποθέσουμε ότι ορισμένες εταιρείες δεν θα αποκαλύψουν αυτήν την υβριδική εταιρική σχέση εκτός αν αναγκάζονται από το νόμο. Ανάλογα με το πλαίσιο, οι εταιρείες θα θέλουν οι χρήστες να πιστεύουν ότι είτε εξυπηρετούνται από έναν πιστό και προσεκτικό άνθρωπο, είτε ένα μαγικό, γνωστό chatbot.

Έτσι, αν ορκιστείτε σε ένα chatbot τα επόμενα χρόνια, ίσως να ορκίζετε και σε έναν άνθρωπο. Ζητήστε από οποιονδήποτε εργαζόμενο τηλεφωνικού κέντρου σχετικά με το συναισθηματικό φόρο της κακοποίησης από τους απρόσωπους πελάτες και θα καταλάβετε πώς ένας συνεργάτης του ανθρώπινου chatbot μπορεί να αισθάνεται επίσης, έχοντας περάσει την ημέρα τους κοσκινίζει μέσα από εκατοντάδες εχθρικά ή ακατάλληλα μηνύματα.

Ρύθμιση ενός παραδείγματος

Όταν ξεκίνησε η Echo του Amazon, πολλοί γονείς ήταν δυσαρεστημένοι. Το πρόβλημα; Η Alexa συμμορφώθηκε με τις απαιτήσεις των παιδιών, ακόμη και αν δεν είπαν «παρακαλώ». Σε απάντηση, η Amazon τελικά πρόσθεσε μια λειτουργία μαγικής λέξης που ευχαριστεί τους χρήστες για να ζητήσουν ωραία, σε μια προσπάθεια να ενισχύσουν τους καλούς τρόπους.

Ο καθορισμός ενός καλού παράδειγμα είναι λοιπόν ένα άλλο επιχείρημα για την ευγένεια. Κάθε γονέας γνωρίζει ότι τα παιδιά μαθαίνουν μιμώντας τη συμπεριφορά των ενηλίκων, οπότε είναι ευγενικό, ακόμη και προς τα αντικείμενα που δεν πρέπει να αντιμετωπίζονται, μπορεί να ενθαρρύνουν τις καλύτερες συνήθειες στα παιδιά και ίσως ακόμη και ενήλικες.

Ο ρόλος του φύλου παίζει επίσης ένα μέρος. Η τελευταία γενιά των βοηθών φωνής είχαν ως επί το πλείστον φωνές που ηχογράφησης, οι οποίες εισάγουν λεπτές αλλά ανεπιθύμητες συνέπειες: οι γυναίκες πρέπει να είναι γραμματείες, πρόθυμοι να ευχαριστήσουν και να υποχωρούν στις επιθυμίες των άλλων. Τα chatbots κειμένου όπως το ChatGPT προγραμματίζονται να μην έχουν παρουσίαση φύλου, αλλά καθώς αυτά τα νέα μοντέλα AI βρίσκουν το δρόμο τους πίσω σε φωνητικά συστήματα, οι ομάδες τεχνολογίας θα πρέπει και πάλι να επιλέξουν πώς αυτοί οι βοηθοί θα πρέπει να ακούγονται και ποια άτομα προβάλλουν. Εάν είμαστε συνήθως αγενείς σε AIS γυναικείων φύλων, ίσως να υποστηρίζουμε άθελά ένα βλαπτικό στερεότυπο της γυναικείας υποταγής.

Βλάπτουμε τον εαυτό μας;

Αυτό, για πολλούς ηθικούς, είναι το σημείο: ακόμα και αν η αγένεια μας δεν βλάψει κάποιον άλλο, μας βλάπτει.

Το 2013, ο ερευνητής της MIT Kate Darling ζήτησε από τους συμμετέχοντες στο συνέδριο βασανιστήρια και διαμέρισμα ρομπότ δεινόσαυροι. Βρήκε ότι οι περισσότεροι άνθρωποι δεν θα το κάνουν, παρόλο που ήξεραν ότι τα πλάσματα δεν μπορούσαν να υποφέρουν. Φαίνεται ότι είμαστε squeamish για να κάνουμε πράγματα που αισθάνονται λάθος ακόμα κι αν δεν κάνουν καμία πραγματική βλάβη.

Για τον φιλόσοφο Immanuel Kant, η αντιμετώπιση των μη ανθρώπινων ζώων μας κρατάει ευγενικό ως είδος και ο ένας προς τον άλλον: «Αυτός που είναι σκληρός στα ζώα γίνεται σκληρός και στις σχέσεις του με τους άνδρες». Ο Καντ λέει ότι οι ορθολογικοί άνθρωποι έχουν καθήκον να δείξουν ενσυναίσθηση και κοινό συναίσθημα, δηλαδή αν είμαστε άδικοι, παραβιάζουμε αυτή τη σημαντική υποχρέωση. Δυστυχώς, ο Καντ φαίνεται να υποστηρίζει ότι αυτό είναι το μόνο λόγος

Να είσαι ευγενικός με τα ζώα, με θέα τα συναισθήματα του ίδιου του ζώου. Οι πιο πρόσφατοι ηθικοί έχουν διορθώσει αυτήν την παράλειψη και συμφωνούν ότι πρέπει να είμαστε ευγενικοί με τα ζώα απλώς και μόνο επειδή μπορούν να υποφέρουν.

Εκτός αυτού, ακόμη και όταν πρόκειται για μη-φαινομενικά μηχανήματα, νομίζω ότι ο Καντ έχει ένα σημείο. Το σοκ μας για κακομεταχείριση, ακόμη και αν δεν προκαλεί άμεση βλάβη, είναι καλό. Είναι σημαντικό ότι η αγένεια αισθάνεται αγενής, ότι η βία αισθάνεται βίαιη. Εάν βρεθήκαμε να χάσουμε τις συναισθηματικές μας απαντήσεις, για παράδειγμα, τα βασανιστήρια ρομπότ ή ακόμα και απλά περιττό εχθρότητα σε ένα chatbot, θα ανησυχούσαμε ότι θα αρχίσαμε να χάνουμε ένα μικρό μέρος αυτού που μας κάνει ηθικούς ανθρώπους.

Μια δεύτερη γνώμη

Όχι κάθε τεχνικός ηθικός μοιράζεται την άποψή μου. Πολλοί δεν έχουν καμία αμφιβολία με το να είναι αγενείς σε chatbots, υποστηρίζοντας ότι πρέπει να δούμε και να αντιμετωπίσουμε το AI ως απλό εργαλείο, ή ακόμα και ως σκλάβος.

Αλλά ίσως υπάρχει μια άλλη γνώμη που μπορούμε να αντλήσουμε. Έτσι ρώτησα ένα chatbot.

«Η αγενής συμπεριφορά μπορεί να αντανακλά άσχημα τον χρήστη: η αγενής σε ένα chatbot μπορεί να θεωρηθεί ως αντανάκλαση του χαρακτήρα και της συμπεριφοράς του χρήστη, που μπορεί να επηρεάσει αρνητικά την προσωπική ή επαγγελματική τους φήμη».

Συμφωνώ αρκετά. Παρόλο που η ευγένεια μπορεί να φαίνεται ιδιότροπη ή ακόμα και περιττή όταν μιλάμε με μηχανές, οι καλοί τρόποι δεν κοστίζουν τίποτα. Νομίζω ότι αξίζει τον κόπο.

Προτεινόμενη φωτογραφία από D Koi επί Ανυψωμένος